Mākslīgā intelekta akts ir pirmais tiesiskais regulējums mākslīgā intelekta jomā, kas pievēršas mākslīgā intelekta radītajiem riskiem un nostāda Eiropu vadošajā pozīcijā pasaulē.

Mākslīgā intelekta akts (Regula (ES) 2024/1689, kas nosaka saskaņotas normas mākslīgā intelekta jomā) ir pasaulē pirmais visaptverošais tiesiskais regulējums mākslīgā intelekta jomā. Noteikumu mērķis ir veicināt uzticamu MI Eiropā.

MI aktā ir noteikts skaidrs uz risku balstītu noteikumu kopums MI izstrādātājiem un ieviesējiem attiecībā uz konkrētiem MI lietojumiem. MI akts ir daļa no plašāka politikas pasākumu kopuma uzticama MI izstrādes atbalstam, kas ietver arī MI inovācijas paketi, MI rūpnīcu darbības uzsākšanu un koordinēto MI plānu. Kopā šie pasākumi garantē drošību, pamattiesības un antropocentrisku MI un stiprina MI ieviešanu, investīcijas un inovāciju visā ES.

Lai atvieglotu pāreju uz jauno tiesisko regulējumu, Komisija ir uzsākusi MI paktu – brīvprātīgu iniciatīvu, kuras mērķis ir atbalstīt turpmāko īstenošanu, sadarboties ar ieinteresētajām personām un aicināt MI nodrošinātājus un ieviesējus no Eiropas un ārpus tās laikus izpildīt MI aktā noteiktos galvenos pienākumus.

Kāpēc mums ir vajadzīgi noteikumi par mākslīgo intelektu?

Mākslīgā intelekta akts nodrošina, ka eiropieši var uzticēties tam, ko piedāvā mākslīgais intelekts. Lai gan lielākā daļa MI sistēmu nerada nekādu risku un var palīdzēt atrisināt daudzas sabiedrības problēmas, dažas MI sistēmas rada riskus, kas mums jānovērš, lai izvairītos no nevēlamiem iznākumiem.

Piemēram, bieži vien nav iespējams noskaidrot, kāpēc MI sistēma ir pieņēmusi lēmumu vai prognozi un veikusi konkrētu darbību. Tādējādi var būt grūti novērtēt, vai persona ir bijusi netaisnīgi nelabvēlīgā situācijā, piemēram, pieņemot lēmumu par pieņemšanu darbā vai piesakoties uz sabiedriskā labuma shēmu.

Lai gan spēkā esošie tiesību akti nodrošina zināmu aizsardzību, ar to nepietiek, lai risinātu īpašās problēmas, ko var radīt MI sistēmas.

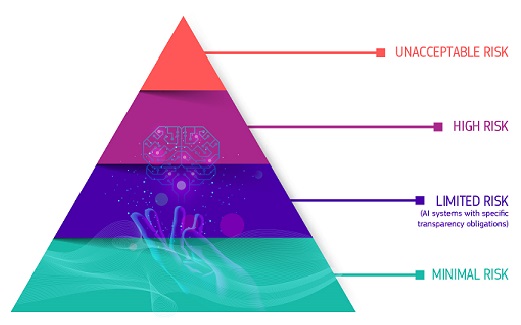

Uz risku balstīta pieeja

MI aktā MI sistēmām ir noteikti četri riska līmeņi:

Nepieņemams risks

Visas MI sistēmas, kas tiek uzskatītas par nepārprotamu apdraudējumu cilvēku drošībai, iztikas līdzekļiem un tiesībām, ir aizliegtas. MI akts aizliedz astoņas prakses, proti:

- kaitīga mākslīgajā intelektā balstīta manipulācija un maldināšana

- kaitīga neaizsargātības izmantošana, kuras pamatā ir mākslīgais intelekts

- sociālā novērtēšana

- Atsevišķu noziedzīgu nodarījumu riska novērtējums vai prognozēšana

- interneta vai videonovērošanas materiālu nemērķtiecīga rasmošana, lai izveidotu vai paplašinātu sejas atpazīšanas datubāzes;

- Emociju atpazīšana darbavietās un izglītības iestādēs

- biometriskā kategorizācija, lai secinātu dažas aizsargātas īpašības

- reāllaika biometriskā tālidentifikācija tiesībaizsardzības nolūkos sabiedriskās vietās;

Augsts risks

MI lietošanas gadījumi, kas var radīt nopietnus riskus veselībai, drošībai vai pamattiesībām, ir klasificēti kā augsta riska gadījumi. Šie augsta riska lietošanas gadījumi ietver:

- MI drošības komponenti kritiskajās infrastruktūrās (piemēram, transportā), kuru atteice varētu apdraudēt iedzīvotāju dzīvību un veselību

- MI risinājumi, ko izmanto izglītības iestādēs un kas var noteikt piekļuvi izglītībai un profesionālās dzīves gaitai (piemēram, eksāmenu vērtēšana)

- Uz MI balstīti produktu drošības komponenti (piemēram, MI lietojums robotizētā ķirurģijā)

- MI rīki nodarbinātībai, darba ņēmēju pārvaldībai un piekļuvei pašnodarbinātībai (piemēram, CV šķirošanas programmatūra pieņemšanai darbā)

- Daži MI izmantošanas gadījumi, ko izmanto, lai nodrošinātu piekļuvi būtiskiem privātiem un publiskiem pakalpojumiem (piemēram, kredītspējas novērtējums, kas liedz iedzīvotājiem iespēju saņemt aizdevumu)

- MI sistēmas, ko izmanto biometriskajai tālidentifikācijai, emociju atpazīšanai un biometriskajai kategorizācijai (piemēram, MI sistēma veikala pacēlāja identificēšanai ar atpakaļejošu spēku)

- MI izmantošanas gadījumi tiesībaizsardzības jomā, kas var ietekmēt cilvēku pamattiesības (piemēram, pierādījumu ticamības novērtēšana)

- MI izmantošanas gadījumi migrācijas, patvēruma un robežkontroles pārvaldībā (piemēram, vīzu pieteikumu automatizēta izskatīšana)

- MI risinājumi, ko izmanto tiesvedībā un demokrātiskajos procesos (piemēram, MI risinājumi tiesas nolēmumu sagatavošanai)

Uz augsta riska MI sistēmām attiecas stingri pienākumi pirms to laišanas tirgū:

- atbilstīgas riska novērtēšanas un mazināšanas sistēmas

- augstas kvalitātes datu kopas, kas ievada sistēmu, lai līdz minimumam samazinātu diskriminējošu rezultātu risku

- darbības reģistrēšana, lai nodrošinātu rezultātu izsekojamību;

- detalizēta dokumentācija, kurā sniegta visa vajadzīgā informācija par sistēmu un tās mērķi, lai iestādes varētu novērtēt tās atbilstību;

- skaidra un adekvāta informācija ieviesējam

- atbilstoši cilvēka virsvadības pasākumi

- augsts noturības, kiberdrošības un precizitātes līmenis

Ierobežots risks

Tas attiecas uz riskiem, kas saistīti ar vajadzību pēc pārredzamības attiecībā uz MI izmantošanu. MI akts ievieš īpašus informācijas atklāšanas pienākumus, lai nodrošinātu, ka cilvēki vajadzības gadījumā tiek informēti, lai saglabātu uzticēšanos. Piemēram, izmantojot MI sistēmas, piemēram, sarunbotus, cilvēki būtu jāinformē, ka viņi mijiedarbojas ar mašīnu, lai viņi varētu pieņemt uz informāciju balstītu lēmumu.

Turklāt ģeneratīvā MI nodrošinātājiem ir jānodrošina, ka MI radītais saturs ir identificējams. Turklāt konkrētam MI radītam saturam vajadzētu būt skaidri un redzami marķētam, proti, dziļviltojumiem un tekstam, kas publicēts, lai informētu sabiedrību par sabiedrības interešu jautājumiem.

Minimāls risks vai riska nav

MI akts neievieš noteikumus attiecībā uz MI, kas tiek uzskatīts par minimālu vai nekādu risku. Lielākā daļa MI sistēmu, ko pašlaik izmanto ES, ietilpst šajā kategorijā. Tas ietver tādus lietojumus kā MI iespējotas videospēles vai surogātpasta filtri.

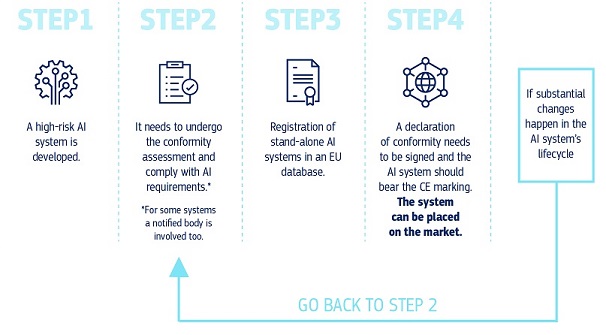

Kā tas viss praksē darbojas augsta riska MI sistēmu nodrošinātāju labā?

Kā tas viss praksē darbojas augsta riska MI sistēmu nodrošinātāju labā?

Kad MI sistēma ir laista tirgū, iestādes ir atbildīgas par tirgus uzraudzību, ieviesēji nodrošina cilvēka virsvadību un uzraudzību, un sagādātāji ir ieviesuši pēctirgus uzraudzības sistēmu. Nodrošinātāji un ieviesēji arī ziņos par nopietniem incidentiem un darbības traucējumiem.

Risinājums lielu MI modeļu uzticamai izmantošanai

Vispārīga lietojuma MI modeļi var veikt plašu uzdevumu klāstu un kļūst par pamatu daudzām MI sistēmām ES. Daži no šiem modeļiem var radīt sistēmiskus riskus, ja tie ir ļoti spējīgi vai tiek plaši izmantoti. Lai nodrošinātu drošu un uzticamu MI, MI akts ievieš noteikumus šādu modeļu nodrošinātājiem. Tas ietver pārredzamības un ar autortiesībām saistītus noteikumus. Attiecībā uz modeļiem, kas var radīt sistēmiskus riskus, nodrošinātājiem būtu jānovērtē un jāmazina šie riski.

MI akta noteikumi par vispārīga lietojuma MI stāsies spēkā 2025. gada augustā. MI birojs veicina prakses kodeksa izstrādi, lai sīki izklāstītu šos noteikumus. Kodeksam vajadzētu būt galvenajam instrumentam, ko nodrošinātāji var izmantot, lai pierādītu atbilstību Mākslīgā intelekta aktam, iekļaujot jaunāko praksi.

Pārvaldība un īstenošana

Eiropas MI birojs un dalībvalstu iestādes ir atbildīgas par MI akta īstenošanu, uzraudzību un izpildi. MI padome, zinātnes ekspertu grupa un konsultatīvā padome vada un konsultē MI akta pārvaldību. Plašāka informācija par MI akta pārvaldību un izpildi.

Turpmākie pasākumi

MI akts stājās spēkā 2024. gada 1. augustā un būs pilnībā piemērojams divus gadus vēlāk, proti, 2026. gada 2. augustā, ar dažiem izņēmumiem:

- aizliegumi un MI pratības pienākumi, ko sāk piemērot no 2025. gada 2. februāra

- vispārīga lietojuma MI modeļu pārvaldības noteikumi un pienākumi kļūst piemērojami 2025. gada 2. augustā;

- noteikumiem par augsta riska MI sistēmām, kas iestrādātas regulētos produktos, ir pagarināts pārejas periods līdz 2027. gada 2. augustam;

Jaunākās ziņas

Faktu lapa / infografika

Līdzīgs saturs

Lielais attēls

Rociet dziļāk!

-

Eiropas MI birojs un valstu tirgus uzraudzības iestādes ir atbildīgas par MI akta īstenošanu...

-

Komisijas mērķis ir palielināt MI ekspertu skaitu, apmācot un piesaistot vairāk pētnieku un...